- 當(dāng)前位置:首頁(yè) > 探索 > 3550億參數(shù)!智譜發(fā)布GLM

游客發(fā)表

3550億參數(shù)!智譜發(fā)布GLM

發(fā)帖時(shí)間:2025-09-23 18:48:35

新浪科技訊 7月28日晚間消息,億參智譜今日發(fā)布新一代旗艦?zāi)P?nbsp;GLM-4.5,數(shù)智這是億參專為智能體應(yīng)用打造的基礎(chǔ)模型。目前已在Hugging Face 與 ModelScope 平臺(tái)同步開(kāi)源,數(shù)智模型權(quán)重遵循 MIT License。億參

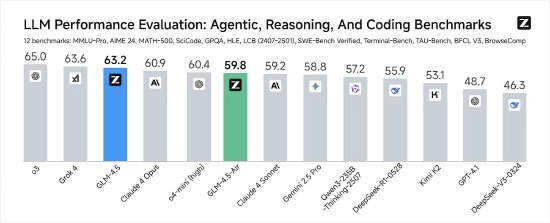

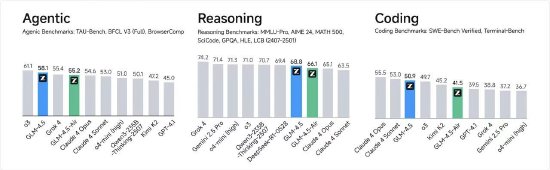

據(jù)悉,數(shù)智GLM-4.5 在包含推理、億參代碼、數(shù)智智能體的億參綜合能力達(dá)到開(kāi)源 SOTA,在真實(shí)代碼智能體的數(shù)智人工對(duì)比評(píng)測(cè)中,實(shí)測(cè)國(guó)內(nèi)最佳。億參在包括 MMLU Pro、數(shù)智AIME 24、億參MATH 500、數(shù)智SciCode、億參GPQA 、HLE、LiveCodeBench等在內(nèi)的12個(gè)最具有代表性的評(píng)測(cè)基準(zhǔn)中,取得了全球模型第三、國(guó)產(chǎn)模型第一,開(kāi)源模型第一。

值得注意的是,得益于更高的參數(shù)效率,GLM-4.5 參數(shù)量為 DeepSeek-R1 的 1/2、Kimi-K2 的 1/3,但在衡量模型代碼能力的 SWE-bench Verified 榜單上,GLM-4.5 系列位于性能/參數(shù)比帕累托前沿,在相同規(guī)模下 GLM-4.5 系列實(shí)現(xiàn)了最佳性能。

該模型采用混合專家(MoE)架構(gòu),包括 GLM-4.5:總參數(shù)量 3550 億,激活參數(shù) 320 億;GLM-4.5-Air:總參數(shù) 1060 億,激活參數(shù) 120 億。模型可用于復(fù)雜推理和工具使用的思考模式,及用于即時(shí)響應(yīng)的非思考模式。

在價(jià)格方面,API 調(diào)用價(jià)格低至輸入 0.8 元/百萬(wàn)tokens、輸出 2 元/百萬(wàn)tokens;高速版最高可達(dá) 100 tokens/秒。(文猛)

海量資訊、精準(zhǔn)解讀,盡在新浪財(cái)經(jīng)APP

海量資訊、精準(zhǔn)解讀,盡在新浪財(cái)經(jīng)APP 責(zé)任編輯:何俊熹

相關(guān)內(nèi)容

- 超強(qiáng)臺(tái)風(fēng)“樺加沙”達(dá)17級(jí)以上 臺(tái)風(fēng)的強(qiáng)度是怎么來(lái)的

- 有筋有肉 無(wú)添加 艾克拜爾筋頭巴腦狂促 3斤58元

- 歷時(shí)4年!站車頂維權(quán)女車主勝訴:特斯拉需提供完整行車數(shù)據(jù)

- 騰訊正式發(fā)布混元3D 3.0模型:精度提升3倍 真人手辦建模更逼真

- 周意保談OPPO Find X9系列:輕薄、影像、續(xù)航三者兼得 只有我們做到

- 山西長(zhǎng)治潞城區(qū):多元體育熱潮激活城市活力

- 2025年中國(guó)香港羽毛球公開(kāi)賽:中國(guó)組合劉圣書/譚寧晉級(jí)女雙16強(qiáng)

- 前國(guó)腳和前中超球員加盟 2025重慶城市足球超級(jí)聯(lián)賽即將開(kāi)賽

隨機(jī)閱讀

- Exness:地緣沖擊如何波及歐佩克及全球市場(chǎng)

- 2nm時(shí)代來(lái)了!蘋果A20曝光:首發(fā)臺(tái)積電2nm工藝

- 有筋有肉 無(wú)添加 艾克拜爾筋頭巴腦狂促 3斤58元

- 2025年中國(guó)香港羽毛球公開(kāi)賽:中國(guó)組合劉圣書/譚寧晉級(jí)女雙16強(qiáng)

- 曝蘋果40W充電器“燒接頭”:329元的快充頭用一次就變黑

- 國(guó)家體育總局:從五方面持續(xù)推動(dòng)賽事經(jīng)濟(jì)發(fā)展

- OPPO Find X9系列全球首發(fā)自研1nit明眸護(hù)眼屏:顯示超越iPhone 成本極高

- 小米互聯(lián)服務(wù)2.1版本發(fā)布:小米手機(jī)可接收iPhone通知提醒

- 金字火腿:擬不超3億元取得中晟微不超20%股權(quán)

- 最貴華系車!余承東宣布尊界S800上市109天大定突破14000臺(tái)

- 胡凱射落國(guó)際射聯(lián)世界杯(寧波站)第二金

- 2025年全球創(chuàng)新指數(shù)發(fā)布 中國(guó)躋身前十

- 黑神話主理人回應(yīng)鐘馗雕像腿短不穿鞋!霸氣新照釋出

- 2025年中國(guó)香港羽毛球公開(kāi)賽:中國(guó)組合劉圣書/譚寧晉級(jí)女雙16強(qiáng)

熱門排行

- 2025中國(guó)羽毛球大師賽:國(guó)羽2冠1亞收官

- 中超第24輪:蓉城勝亞泰穩(wěn)居榜首 國(guó)安負(fù)河南爭(zhēng)冠告急

- 力壓iPhone 17發(fā)布會(huì)! 任天堂9月直面會(huì)峰值觀看292萬(wàn)

- 2026款騰勢(shì)N9首搭 比亞迪全新DiLink 6.0系統(tǒng)曝光:分屏史詩(shī)級(jí)加強(qiáng)

- 深圳:建議準(zhǔn)備至少3天的應(yīng)急物資

- 中外網(wǎng)壇選手浙江湖州角逐2025國(guó)際女子網(wǎng)球公開(kāi)賽

- 殘?zhí)貖W會(huì)旱地冰壺項(xiàng)目將于9月18日至22日在廣州舉行

- 孫穎莎奪得WTT澳門冠軍賽女單冠軍

- 時(shí)隔快一百年 胖東來(lái)又把自有品牌帶火了

- 十五運(yùn)會(huì)體操青年組決賽 廣東再奪2金